Anthropic snur: Claude kan nå diskutere eksplosiver og våpen

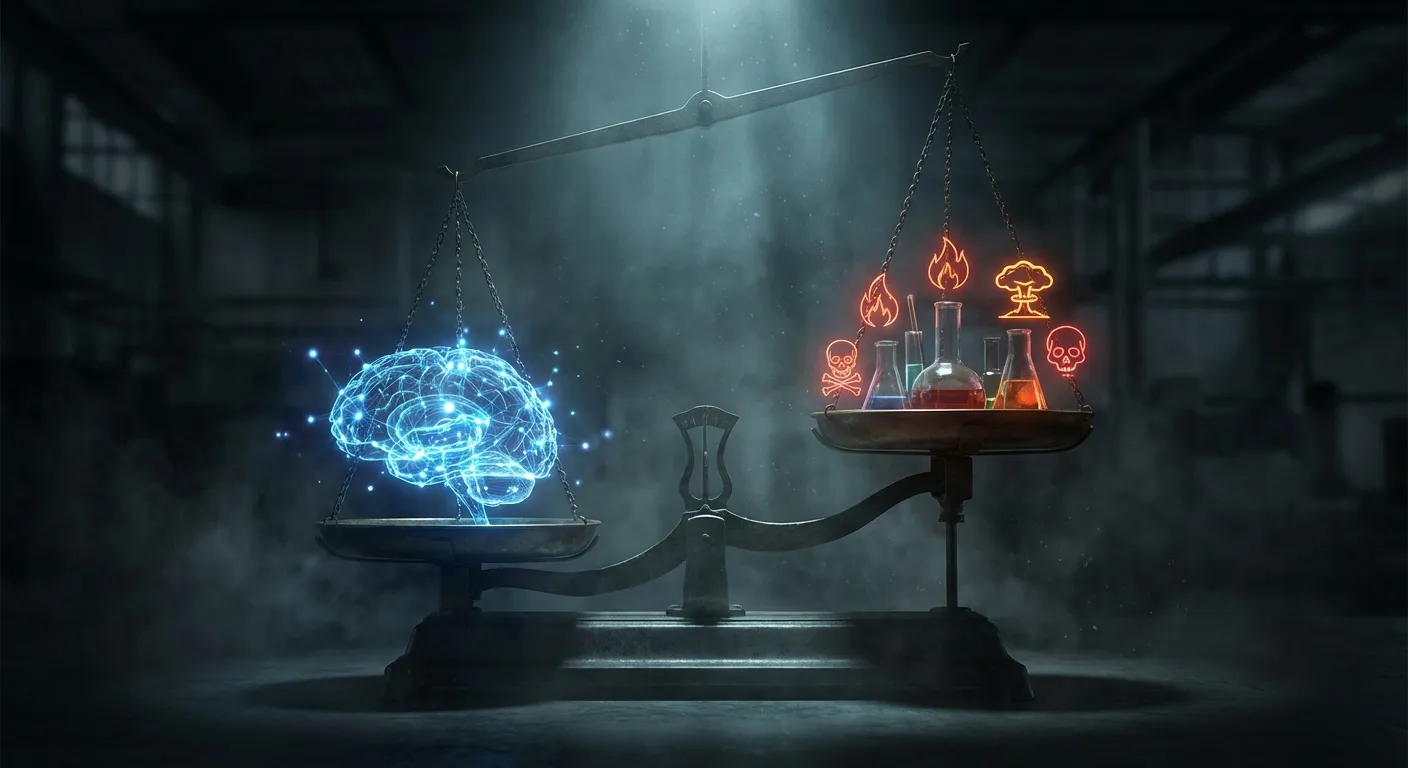

Anthropic, selskapet bak Claude og kjent for sitt fokus på AI-sikkerhet, har stille og rolig oppdatert sine bruksretningslinjer. Den nye policyen tillater Claude å gi detaljert informasjon om våpen, eksplosiver og regulerte stoffer – så lenge informasjonen allerede er tilgjengelig på nettet.

Endringen er ikke en feil. Det er en bevisst beslutning.

Ifølge den oppdaterte policyen kan Claude nå diskutere kjemien bak sprengstoff, mekanikken i skytevåpen og egenskapene til regulerte substanser, forutsatt at informasjonen er offentlig tilgjengelig. Den tidligere policyen trakk en hardere grense, der Claude ofte avslo å svare på spørsmål om farlige temaer uavhengig av kontekst.

Anthropic begrunner endringen med at overdreven sensur ikke gjør noen tryggere. Den gjør bare AI mindre nyttig. En person som virkelig ønsker instruksjoner for å lage et improvisert eksplosiv trenger ikke Claude. De trenger et bibliotekskort, eller fem minutter på det åpne nettet.

Endringen vil i praksis hjelpe forskere som studerer eksplosivkjemi, journalister som undersøker våpenhandel, og sikkerhetsprofesjonelle som vurderer sårbarheter. Alle disse brukergruppene har tidligere møtt en vegg når de stilte fullt legitime spørsmål til Claude.

Skiftet speiler en voksende konsensus i AI-industrien om at absolutte innholdsforbud ikke faktisk beskytter noen. De gjør bare AI-assistenter mindre nyttige, og straffer de ærlige brukerne mens de hjelper de ondsinnede lite eller ingenting.

Anthropic er verdsatt til 61,5 milliarder dollar og ble grunnlagt av tidligere OpenAI-forskere, inkludert Dario og Daniela Amodei. Selskapet har bygget sitt merkevare på å være den ansvarlige aktøren i kunstig intelligens. Denne endringen markerer et merkbart skift i den filosofien.

📬 Likte du denne?

AI-nyheter for ledere. Kuratert av en CIO som bygger det selv. Daglig i innboksen.