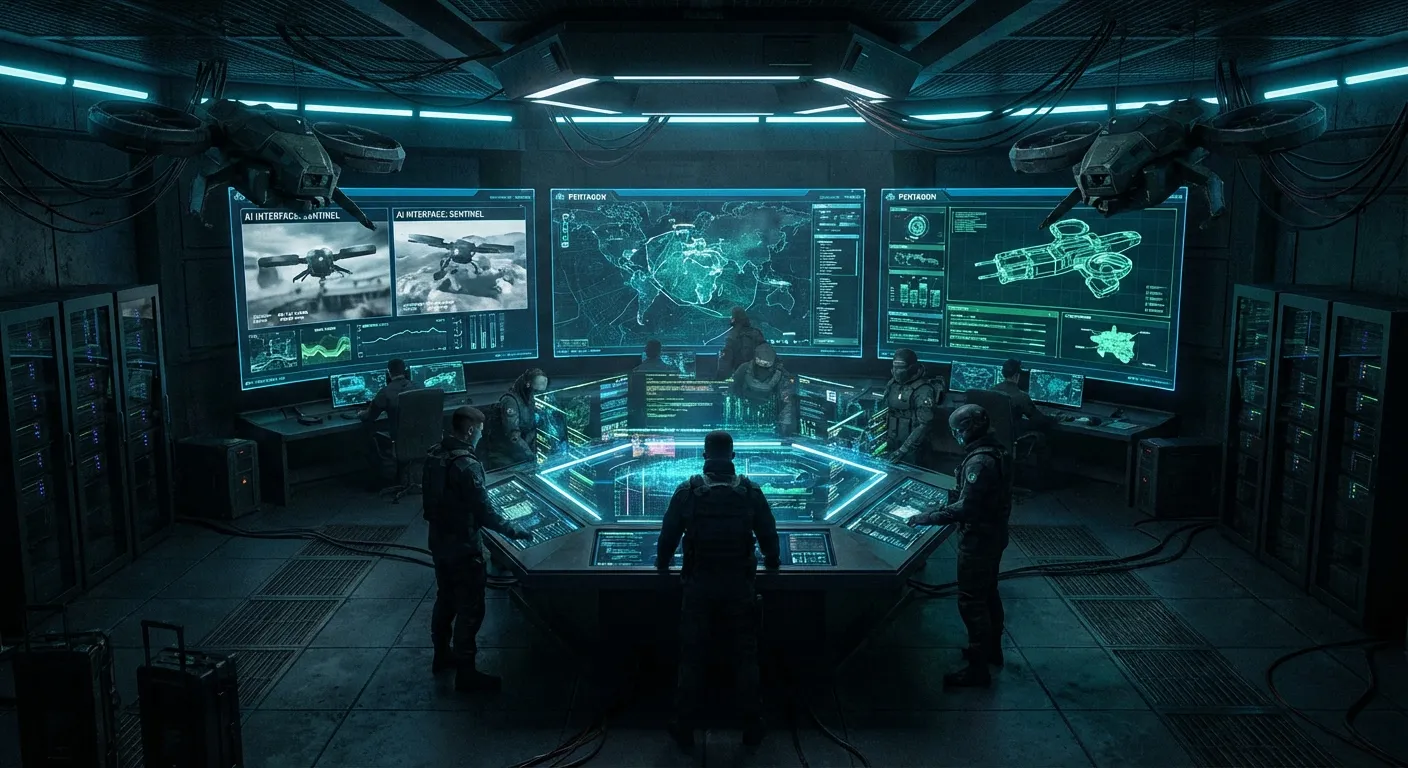

Claude brukes av Pentagon i krig mot Iran

Anthropics AI-modell Claude er i bruk av det amerikanske forsvarsdepartementet under den pågående militære konflikten med Iran. Det bekreftet en Pentagon-tjenestemann tirsdag under en høring i Senatet.

Konfirmasjonen kom som en overraskelse for mange, særlig i lys av den spente relasjonen mellom Anthropic og Pentagon. Selskapet har nemlig satt klare grenser for militær bruk av Claude. De krever at modellen ikke skal brukes til fullt autonome våpensystemer eller masseovervåking av befolkningen.

Disse kravene er i direkte konflikt med en avtale som konkurrenten OpenAI har inngått med forsvarsdepartementet. Resultatet er at Trump-administrasjonen i begynnelsen av mars svartelistet Anthropic som leverandør og utpekte selskapet som en risiko i forsyningskjeden.

Anthropic har svart med søksmål og hevder regjeringens handlinger er et brudd på selskapets konstitusjonelle rettigheter. Demokrater i Senatet, ledet av senator Adam Schiff, arbeider nå med lovgivning som vil lovfeste Anthropics røde linjer for autonome våpen og masseovervåking.

Saken belyser et voksende spenningsforhold mellom AI-selskaper og militære kunder, der grunnleggende spørsmål om hvem som bestemmer over teknologien og til hvilke formål, ikke lenger er hypotetiske.

📬 Likte du denne?

AI-nyheter for ledere. Kuratert av en CIO som bygger det selv. Daglig i innboksen.