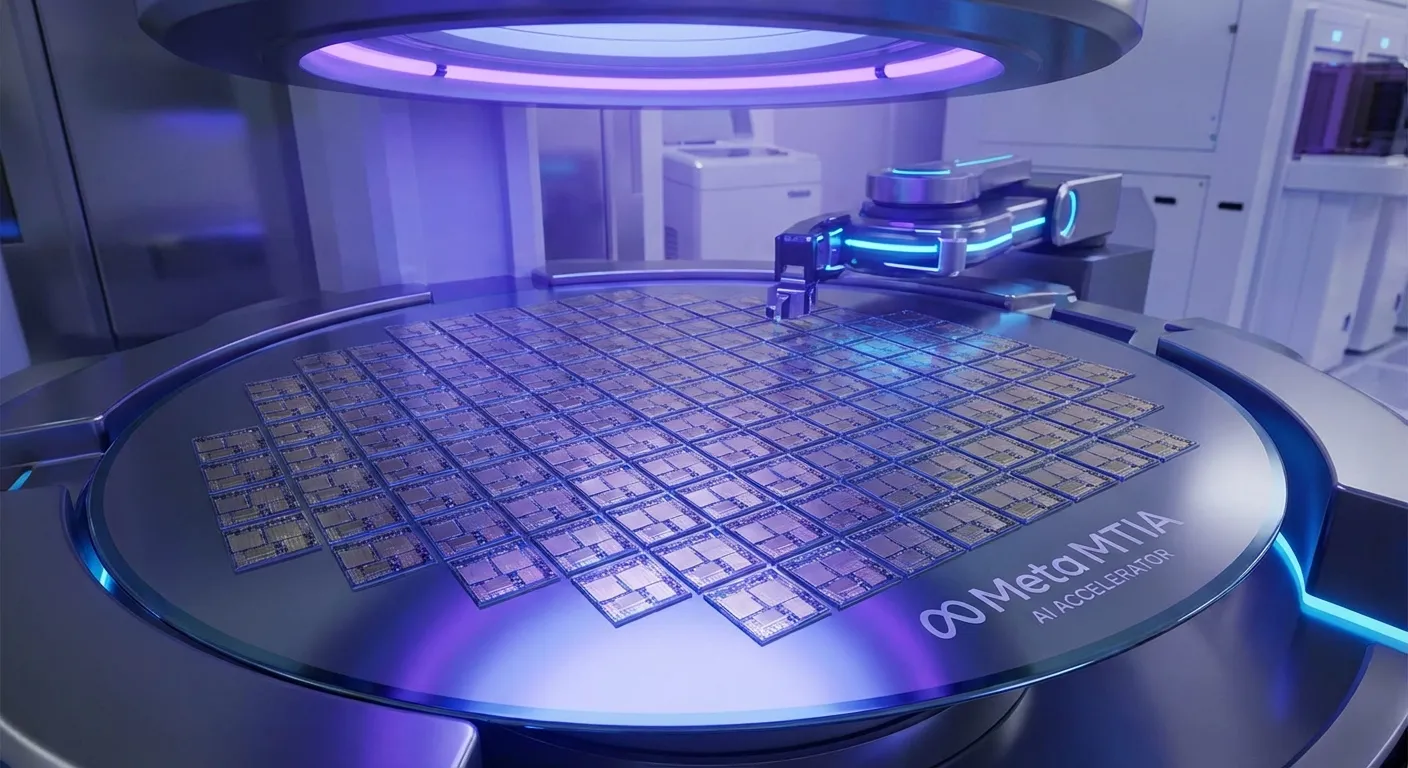

Meta bekrefter Broadcom som chip-partner: Lanserer fire generasjoner MTIA-brikker de neste to årene

Meta har offentlig bekreftet at Broadcom er deres langsiktige partner for utvikling av egendefinerte AI-brikker. Partnerskapet er knyttet til Metas MTIA-serie (Meta Training and Inference Accelerator), og selskapet har nå lagt frem en roadmap som strekker seg over fire generasjoner de neste to årene.

Fire generasjoner MTIA

Ifølge rapporter fra Digitimes og MarketBeat har Meta konkretisert følgende ASIC-roadmap:

- MTIA 300 — allerede i masseproduksjon

- MTIA 400 — under utvikling

- MTIA 450 — planlagt

- MTIA 500 — planlagt

Alle fire generasjoner er designet av Broadcom. Dette representerer et av de største langsiktige chip-partnerskapene i AI-industrien så langt.

Hva betyr dette?

For Meta er egendefinerte brikker en strategisk nødvendighet. Avhengigheten av Nvidia-GPUer er kostbar, og ved å bygge spesialbrikker for inferens (selve kjøringen av AI-modeller) kan selskapet redusere kostnadene massivt ved store volum.

MTIA er primært rettet mot inferens — ikke trening. Det betyr at Meta fortsatt er avhengig av Nvidia H100/H200 og kommende Blackwell-brikker for å trene modellene sine, men at de gradvis kan ta kontroll over den billigere, men volum-intensive inferens-siden.

Kontekst: Metas AI-år

Meldingen kommer i en periode der Meta sliter internt. Selskapet har:

- Kastet "Behemoth" (den største Llama 4-modellen) pga. svake benchmarks

- Forsinket "Avocado"-modellen til minst mai

- Varslet de største permitteringene i selskapets historie (15 000+)

Chip-partnerskapet med Broadcom er ett av få lyspunkter i den interne AI-strategien. Det sender et klart signal til markedet: Meta er committed til AI-infrastruktur på lang sikt, uavhengig av modellutfordringene.

For CIOer og teknologiledere

Trenden er tydelig: Hyperscalers bygger sine egne brikker. AWS (Trainium/Inferentia), Google (TPU), Microsoft (Maia), Apple (Neural Engine) — og nå Meta mer eksplisitt enn noensinne.

For bedrifter som kjøper AI-infrastruktur, betyr dette på sikt at prisene på inferens-API-er vil falle ytterligere, ettersom cloud-leverandørene får bedre marginer på egenproduserte brikker. GPT, Claude og Gemini vil bli billigere å kalle på — ikke fordi AI blir enklere, men fordi selve hardwaren optimaliseres aggressivt.

📬 Likte du denne?

AI-nyheter for ledere. Kuratert av en CIO som bygger det selv. Daglig i innboksen.