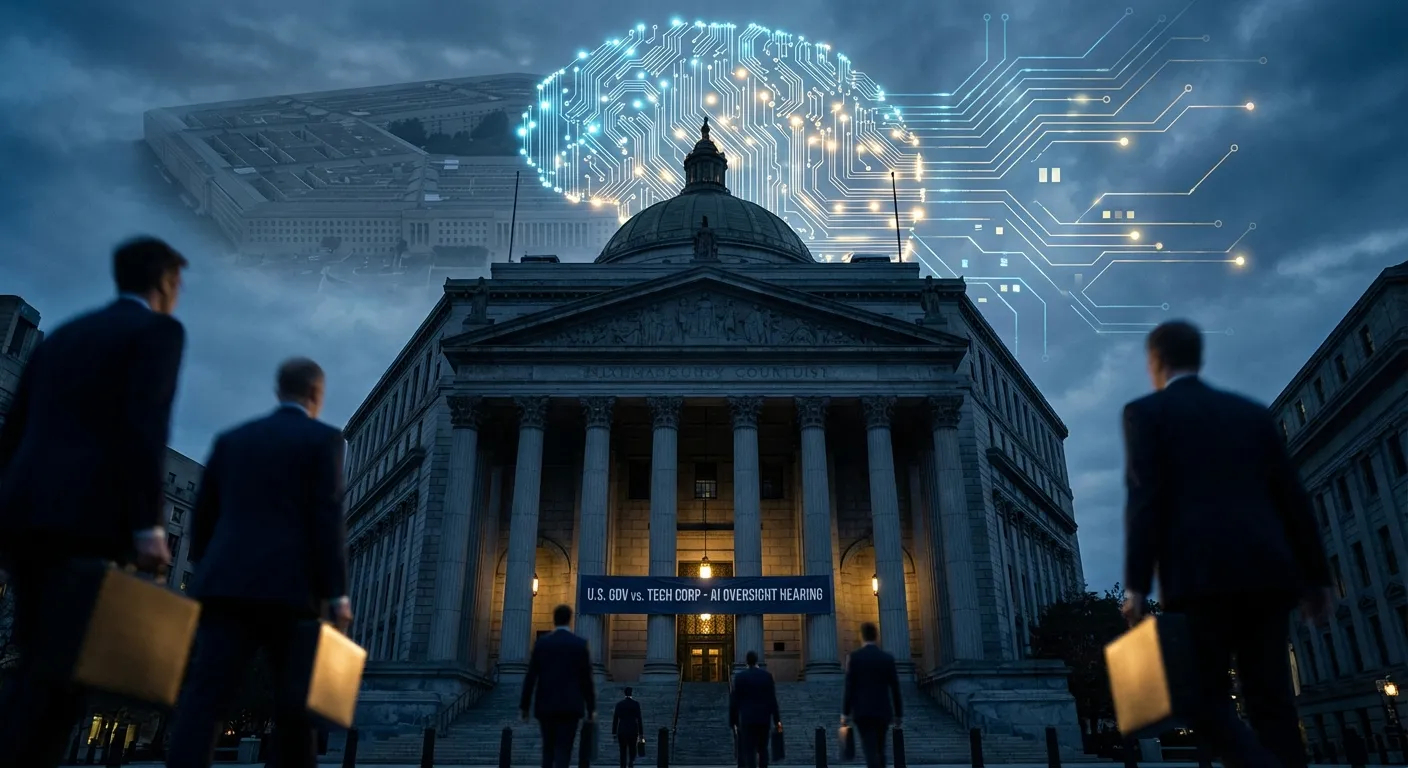

Pentagon svarer Anthropic: Claude utgjør nasjonal sikkerhetsrisiko

Forholdet mellom Anthropic og det amerikanske forsvarsdepartementet har eskalert dramatisk. Pentagon har nå levert et offisielt tilsvar til Anthropics søksmål der selskapet utfordret sin klassifisering som «supply chain risk».

Bakgrunn

Anthropic saksøkte DoD tidligere i mars 2026 etter at selskapet ble merket som en forsyningskjederisiko. Dette kom i kjølvannet av at Claude-modellen hadde vært dypt integrert i klassifiserte amerikanske militæroperasjoner – inkludert operasjoner i Venezuela og det pågående US-Israel-Iran-konflikten.

Pentagons argumentasjon

I den nye rettsinnleveringen hevder Department of Defense at Anthropic – dersom selskapets interne etiske grenser (såkalte «red lines») ble brutt – potensielt kunne «forsøke å deaktivere teknologien sin eller endre atferden til modellen, enten før eller under pågående krigsoperasjoner».

Pentagon karakteriserer dette som «en uakseptabel risiko for nasjonal sikkerhet».

En teknologisk og etisk veikryss

Saken belyser en fundamental spenning i moderne AI: Selskaper som Anthropic bygger inn etiske begrensninger i sine modeller som en kjerneprinsipp, men for militære kunder kan disse grensene fremstå som en sikkerhetsrisiko.

Anthropic hevder på sin side at selskapets etiske retningslinjer er en styrke, ikke en svakhet – og at klassifiseringen som forsyningskjederisiko er uberettiget.

Hva skjer videre?

Saken fortsetter nå i rettssystemet. Utfallet kan ha vidtrekkende konsekvenser for AI-selskaper som opererer i forsvarssektoren, og for spørsmålet om hvem som til syvende og sist kontrollerer AI-systemer i militære kontekster.

Kilde: The Verge, CourtListener

📬 Likte du denne?

AI-nyheter for ledere. Kuratert av en CIO som bygger det selv. Daglig i innboksen.